高效数据湖构建与数据仓库融合 大规模数据架构最佳实践与大数据采集

随着企业数据量的爆炸式增长,构建高效的数据湖并与数据仓库融合,打造大规模数据架构已成为现代组织的关键需求。本文将从数据湖的构建策略、数据仓库的融合方法、最佳实践以及大数据采集技术四个方面,系统性地探讨这一领域的核心内容。

一、高效数据湖的构建策略

数据湖作为存储原始数据的集中式存储库,其高效构建是数据架构的基石。选择合适的存储技术至关重要,例如基于云的对象存储(如AWS S3或Azure Data Lake Storage)能够提供高可扩展性和成本效益。数据湖应支持多种数据格式(如Parquet、ORC),并采用分层存储策略,将热数据、温数据和冷数据分别存储以优化访问性能。引入元数据管理和数据目录工具(如Apache Atlas或AWS Glue)可提升数据发现和治理能力,确保数据质量与合规性。

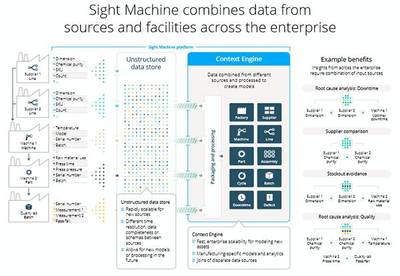

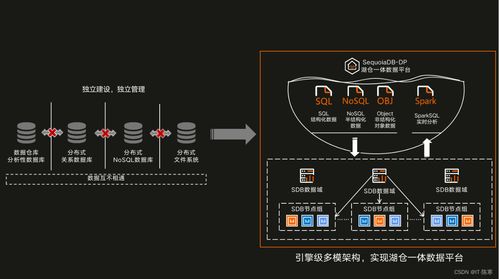

二、数据湖与数据仓库的融合方法

数据湖和数据仓库各有优势:数据湖适合存储原始、多样化的数据,而数据仓库则擅长处理结构化数据并提供高性能查询。融合二者可构建混合架构,实现互补。一种常见方法是使用ELT(Extract, Load, Transform)流程:先将原始数据加载到数据湖,然后利用数据仓库(如Snowflake、BigQuery或Redshift)进行转换和分析。通过数据虚拟化或数据湖查询引擎(如Presto或Spark SQL),用户可以直接在数据湖上执行查询,减少数据移动,提升效率。实施数据治理框架,确保数据在湖和仓库间的一致性,是融合成功的关键。

三、大规模数据架构的最佳实践

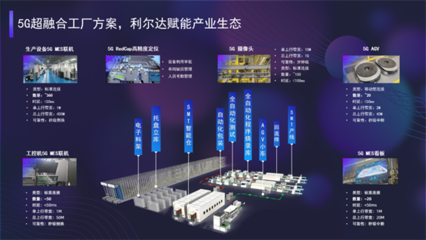

构建大规模数据架构时,需遵循多项最佳实践以保障可扩展性、可靠性和安全性。采用微服务架构和容器化部署(如Kubernetes)可提高系统的弹性和维护性。实施数据分区和索引策略,优化查询性能。安全方面,应启用加密(静态和传输中)、访问控制和审计日志,并遵守GDPR等法规。监控和自动化工具(如Prometheus和Airflow)的使用有助于实时跟踪数据管道健康,减少人工干预。团队协作和文档化是确保架构长期可持续的基础。

四、大数据采集技术与策略

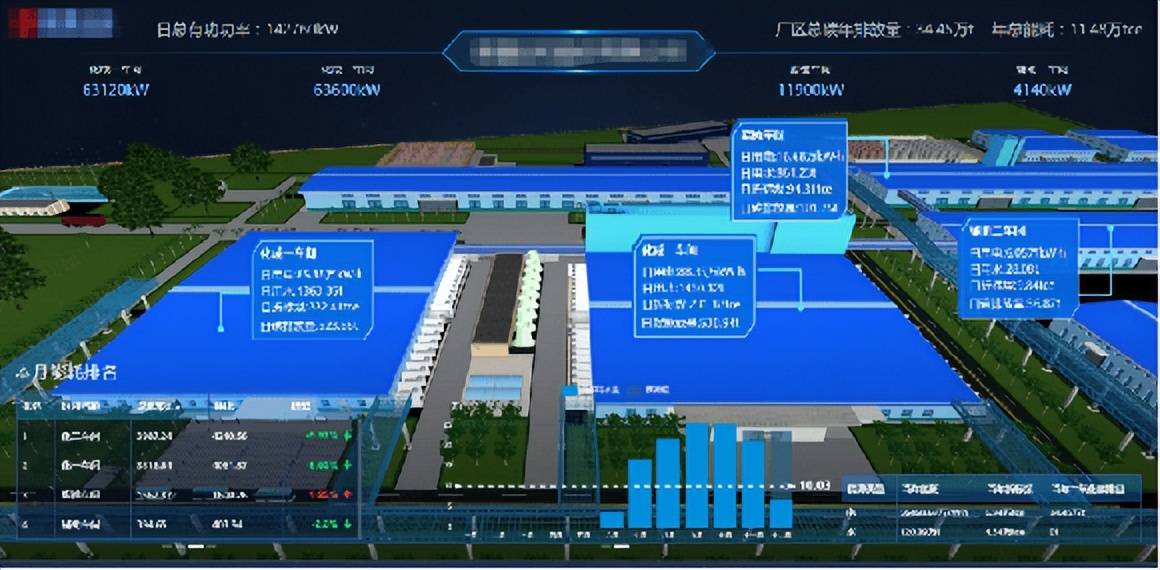

大数据采集是数据湖和仓库的源头,高效采集直接影响整体架构性能。技术层面,可采用批处理(如Apache NiFi或AWS Kinesis Data Firehose)和流处理(如Apache Kafka或Flink)相结合的方式,以应对不同数据源的实时性和批量需求。采集策略上,优先考虑数据源集成(例如从IoT设备、日志文件或第三方API提取数据),并实施数据验证和清洗流程,避免垃圾数据入库。同时,利用CDC(Change Data Capture)技术捕获数据库变更,确保数据同步的准确性。在实践中,评估数据量和延迟要求,选择合适的工具和协议(如RESTful API或消息队列),是优化采集效率的核心。

结论

高效数据湖构建与数据仓库融合,结合大规模数据架构的最佳实践和先进的大数据采集技术,能够为企业提供强大的数据基础。通过合理规划技术栈、强化治理和优化流程,组织可以释放数据的全部潜力,驱动业务创新和决策智能化。未来,随着AI和边缘计算的发展,这一架构将不断演进,适应更复杂的数据生态。

如若转载,请注明出处:http://www.antscloudsec.com/product/17.html

更新时间:2025-11-29 16:06:25